Yapay zeka algoritmaları ve bunları kullanan platformlar, tasarımcılar tarafından manipüle edilerek, siyaset başta olmak üzere birçok alanda kötü amaçlı kullanılıyor. Yapay zeka uzmanı Sercan Okur, yapay zekanın bir araç olduğunu, ahlaklı bir şekilde kullanıldığında toplumsal fayda oluşturduğunu belirtiyor.

Tarafsız olması beklenen Yapay Zeka’nın taraflı tutumu

Ülkemizde son dönemde yaygınlaşan Yapay Zeka kavramı, ilk kez batıda ortaya çıkmıştı. 1950’li yılların başında İngiliz matematikçi, bilgisayar bilimcisi ve kriptolog Alan Turing’in “Makineler Düşünebilir Mi?” sorusuyla makine öğrenmesi kavramı ortaya çıkmış; “Yapay Zekâ” terimi ise, Bilgisayar Bilimci ve Bilişsel Bilimci bir İngiliz olan John McCarthy tarafından, ABD’de Dartmouth Koleji isimli üniversitede, ilk kez düzenlenen yapay zekâ konferansı olan Dartmouth Konferansı’nda 1956 yılında kullanılmıştır. O günden bu yana hızlı bir gelişim süreci gösteren Yapay Zeka, neredeyse tüm sektörlerde kendine yer bulmuştur.

Yapay zeka sistemleri son dönemde ise, yanlı ve ahlaki olmayan tutumlarıyla gündeme geliyor.

Meta’nın yapay zeka aracı Meta AI, Cumhuriyetçi Partiden başkanlık için yarışan eski ABD Başkanı Donald Trump’a yönelik suikast girişimiyle ilgili bilgi talebine cevap vermedi. Buna karşılık başkan adayı olması beklenen ABD Başkan Yardımcısı Kamala Harris’in seçim kampanyasına dair bilgi vermesi istenildiğinde ise detaylı bilgiler paylaştı.

Google da çeşitli arama önerilerinde Trump’a yer vermedi.

Öte yandan sosyal medya platformlarındaki bazı içerikler de, yapay zeka tabanlı sistemler kullanılarak sistemden kaldırılıyor. Örneğin, İran’ın başkenti Tahran’da suikasta uğrayan Hamas Siyasi Büro Başkanı İsmail Heniyye için Facebook ve Instagram’da yapılan paylaşımların birçoğu, kullanım politikalarını ihlal ettiği gerekçesiyle kaldırıldı.

Daha önce de Facebook’ta Filistin hakkında içerik paylaşan hesap ve sayfaların, kullanım koşullarını ihlal ettiği gerekçesiyle kapatıldığı, Filistin’i savunan paylaşımların yapılmasının engellendiği de gündeme gelmişti.

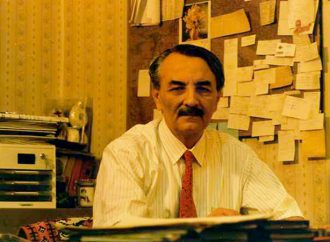

Sercan Okur: Algoritmayı oluşturan arkadaki aklın isteğiyle ilgili bir durum

Yapay zeka ve siber güvenlik uzmanı, Pavo Siber Güvenlik Yönetici Direktörü Sercan Okur, yapay zeka algoritmalarının ayrımcı tutumuna ilişkin AA muhabirine açıklamada bulundu.

Yapay zeka modelleri oluşturulurken mühendisliğin yanı sıra paylaşılan içeriklerin profillenmesi için profil uzmanlarıyla da yakından çalışıldığını anlatan Okur, “Bu modellerin yönlendirilmesi oldukça mümkün. Algoritmayı oluşturan arkadaki aklın, algoritmayı kullananları nereye doğru yönlendirmek istemesiyle ilgili bir durum. Örneğin yapay zeka bugün Trump’ı önermiyor, bu durum yarın başka bir isim için yaşanabilir. Trump’ı öne çıkarıp, Kamala Harris’e dair içerikleri geride bırakabilir.” diye konuştu.

Sercan Okur, yapay zekanın kendisini oluşturanlar tarafından yönlendirilebildiğine dikkati çekerek, “Yapay zekayı çocuk yetiştirme sürecine benzetebiliriz. Örneğin bir anne baba, çocuğunu etik çerçevede yetiştirirken, bir diğeri toplumsal ahlak kurallarına dikkat etmeden yetiştirebilir. Her yapay zeka modelinin arkasında bir şirket var ve bu modeller kolaylıkla manipüle edilebilir.” dedi.

‘Yapay zeka araçları genellikle şeffaf değil’

Sercan Okur, yapay zeka araçlarının genellikle şeffaf olmadığını belirterek, “Açık kaynak kodlu yapay zeka projeleri daha şeffaf. Bu projelerde bağımsız denetmenler kodları inceleyebiliyor, kodun herhangi bir yerinde manipülasyon varsa kolay bir şekilde ifşa olabiliyor.” ifadesini kullandı.

Kapalı kutu algoritmaların ise tamamen manipülasyona açık olduğunu anlatan Okur, bu algoritmaların siyasi, finansal her türlü amaç için kullanılabileceğinin altını çizdi.

Devletler bu konuya daha yeni eğiliyor

Sercan Okur, Avrupa Birliği’nde yapay zekanın etik kullanımına yönelik yasanın olduğuna işaret ederek, “ABD’de buna benzer çalışmalar var. Şu anda yapay zeka kolaylıkla manipüle edilebilir çünkü bağımsız denetim konusunda bir pratik yok.” dedi.

Okur, son dönemde Filistin’le ilgili paylaşımların sosyal medya platformlarından kaldırılmasına yönelik olarak, paylaşım kaldırma sürecinin otomatize edilmiş bir yapısı olduğunu söyledi. Milyarlarca paylaşım arasından, içinde Filistin geçen bütün paylaşımların silinmesi komutunun verilemeyeceğini anlatan Okur, bu komutun verilmesi halinde içinde Filistin geçen, kaldırılmak istenmeyen paylaşımların da silinebileceğini belirtti.

‘Paylaşımların içeriği, yapay zeka sayesinde sınıflandırılıyor’

Sercan Okur, içeriklerin kaldırılması sürecinde duygu analizinin önem taşıdığına değinerek, sözlerini şöyle sürdürdü:

“Filistin’i öven ya da eleştiren bir paylaşım mı olduğunu, içeriğin kategorize edilmesini, yapay zeka ile sağlıyorlar. İçeriğin duygularını skorlayan algoritmalar var. Yapay zeka tüm içerikleri tarıyor, sınıflandırmasını yapıyor. Yapay zekayı yöneten kurum, Filistin’le ilgili pozitif paylaşımları otomatik sil diyebilir. Böylece sadece Filistin’e destek veren paylaşımlar kaldırılmış olur. Bu noktada arka planda yapay zeka kullanılıyor.”

‘Yapay zeka bir araçtır, onu yönetenler yönlendirir’

Yapay zekanın bir araç olduğunu ve bu araca ne yapması gerektiğini onu yöneten insanların söylediğini aktaran Okur, “Yapay zeka destekli bu araçlar uygunsuz içeriklerin, dolandırıcılık amaçlı paylaşımların kaldırılmasında da etkin şekilde kullanılıyor. Yapay zeka etik bir şekilde kullanıldığında toplumsal bir fayda oluşturuluyor.” dedi.

Leave a Comment

Your email address will not be published. Required fields are marked with *